فایل robots.txt یک فایل متنی است که در ریشه وبسایت قرار میگیرد و به عنوان یک پروتکل ارتباطی بین وبسایت شما و موتورهای جستجو عمل میکند. این فایل به موتورهای جستجو دستور میدهد که کدام بخشهای سایت شما قابل خزش و ایندکس شدن است و کدام بخشها باید از این فرآیند مستثنی شوند. با استفاده از این فایل، میتوانید به طور موثر بر نحوهی دیده شدن سایتتان در نتایج جستجو تاثیر بگذارید. در ادمه به فایل robot.txt چیست؟ و اهمیت ان میپردازیم.

آژانس دیجیتال مارکتینگ مازاریت با داشتن سالها تجربه در زمینه سئو، میتواند به شما در ایجاد و بهینهسازی فایل robots.txt کمک کند تا بهترین نتیجه را از کمپینهای سئوی خود بگیرید.

چرا استفاده از فایل robots.txt اهمیت دارد؟

–جلوگیری از کنیبالیزیشن

آیا تا به حال متوجه شدهاید که چندین صفحه از سایتتان برای یک کلمه کلیدی خاص در نتایج جستجو نمایش داده میشود؟ این اتفاق که کنیبالیزیشن نام دارد، زمانی رخ میدهد که چندین صفحه از سایت شما با هم رقابت میکنند تا برای یک عبارت خاص رتبه بگیرند. این رقابت داخلی میتواند به جای بهبود رتبهبندی سایتتان، آن را کاهش دهد. فایل robots.txt به شما کمک میکند تا صفحات تکراری را مشخص کرده و از ایندکس شدن آنها جلوگیری کنید.

–پنهان کردن فایلها از چشم موتورهای جستجو

آیا میخواهید برخی از فایلهای سایتتان مانند PDF، تصاویر یا ویدیوها در نتایج جستجو نمایش داده نشوند؟ طریق فایل robots.txt شما در واقع به موتورهای جستجو میگویید که کل صفحه را ایندکس نکنند .

این کار نه تنها به شما کمک میکند تا کنترل بیشتری بر روی محتوای قابل ایندکس سایتتان داشته باشید، بلکه میتواند به بهبود سئوی کلی سایت نیز کمک کند.

–مدیریت ترافیک رباتها

آیا میدانید که تعداد زیادی ربات به طور مداوم در حال بازدید از سایت شما هستند؟ این رباتها، اغلب موتورهای جستجو هستند که برای بهروزرسانی فهرست نتایج جستجو، محتوای سایت شما را بررسی میکنند. اما تعداد زیاد این رباتها میتواند باعث کند شدن سایت و حتی ایجاد اختلال در عملکرد سرور شود.

با استفاده از فایل robots.txt میتوانید به موتورهای جستجو بگویید که کدام بخشهای سایت شما مهمتر هستند و کدام بخشها را میتوانند نادیده بگیرند.

–رعایت قوانین کپیرایت

اگر شما محتوای تحت کپیرایت را در سایت خود استفاده میکنید، باید اطمینان حاصل کنید که این محتوا به طور ناخواسته توسط موتورهای جستجو ایندکس نشود. یکی از راههای جلوگیری از این اتفاق، استفاده از فایل robots.txt است.

بیشترخوانید: انواع بازاریابی دیجیتال چیست؟ راهنمای کامل برای کسبوکارهای آنلاین

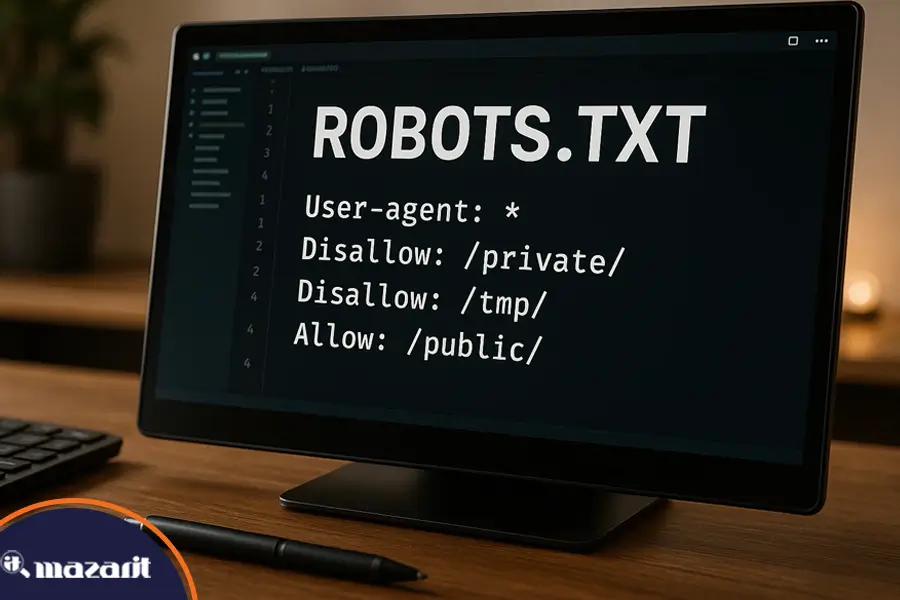

فایل robot.txt چیست؟آشنایی دستورات اصلی آن

- User-agent: این دستور مشخص میکند که دستورات بعدی برای کدام جستجوگر (مانند Googlebot، Bing bot و …) اعمال میشود. با استفاده از علامت ستاره (*) میتوانید دستورات را برای همه خزندهها اعمال کنید.

- Disallow: این دستور مشخص میکند که کدام صفحات یا پوشهها نباید ایندکس شوند.

- Allow: این دستور به صورت استثنا، اجازه ایندکس شدن یک صفحه یا پوشه خاص را میدهد.

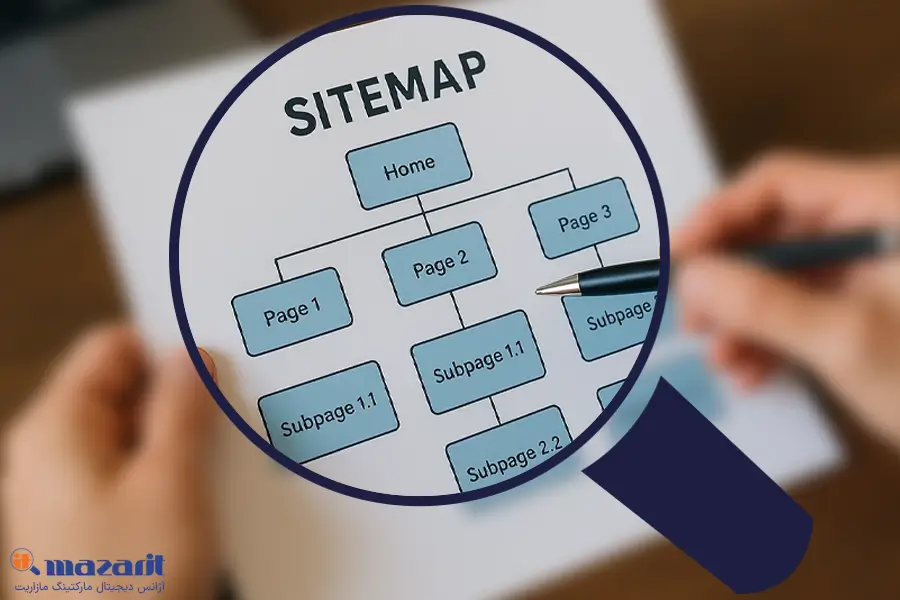

- Sitemap: این دستور آدرس نقشه سایت XML شما را مشخص میکند. نقشه سایت به موتورهای جستجو کمک میکند تا صفحات مهم سایت شما را به سرعت پیدا کنند.

- Crawl-delay: این دستور به موتورهای جستجو میگوید که بین درخواستهای متوالی برای خزش صفحات، حداقل چند ثانیه صبر کنند.

– مثال یک فایل robots.txt

User-agent: *

Disallow: /admin/

Disallow: /tmp/

Sitemap: https://mazarit.com/sitemap.xml

همه رباتهای جستجوگر (User-agent: *)

به دایرکتوریهای admin و tmp دسترسی ندارند (Disallow: /admin/, Disallow: /tmp/)

و فایل sitemap.xml در آدرس https://mazarit.com/sitemap.xml قرار دارد.

مشاهده robots.txt یک سایت

برای مشاهده فایل robots.txt یک سایت، کافیست آدرس اصلی سایت را در نوار آدرس مرورگر خود وارد کرده، سپس پس از یک اسلش، عبارت “robots.txt” را تایپ کنید.

به عنوان مثال، برای مشاهده فایل robots.txt سایت example.com، آدرس را در نوار آدرس وارد و سپس کلید Enter را بزنید. با این کار، اگر سایت دارای فایل robots.txt باشد، محتوای آن نمایش داده میشود. در غیر این صورت، با پیغام خطای 404 مواجه خواهید شد که نشان میدهد سایت وجود ندارد.

ساخت فایل robots.txt

برای ایجاد فایل robots.txt و کنترل نحوهی دسترسی موتورهای جستجو به صفحات وبسایتتان، ابتدا به بخش مدیریت هاست خود (مانند cPanel یا Direct Admin) مراجعه کنید.

بخش مدیریت فایلها، به پوشهای که فایلهای اصلی وبسایتتان در آن قرار دارد (معمولاً public_ html) بروید. در این پوشه، یک فایل متنی جدید ایجاد کرده و نام آن را دقیقاً “robots.txt” (با حروف کوچک و بدون هیچ پسوندی) بنویسید.

سپس با استفاده از یک ویرایشگر متنی ساده مانند Notepad یا TextEdit، این فایل را باز کنید و دستورات مورد نظر را در آن وارد نمایید. پس از وارد کردن دستورات، تغییرات را ذخیره کرده و فایل را مجدداً در پوشه public _html در هاست خود جایگزین کنید.

بیشتربخوانید: چگونه از اینترنت کسب درآمد کنیم

تست فایل robots.txt در ابزار گوگل

- ورود به Google Search Console: به کنسول جستجوی گوگل خود وارد شوید.

- انتخاب سایت: سایتی که میخواهید فایل robots.txt آن را تست کنید، انتخاب کنید.

- رفتن به بخش Crawl: در منوی سمت چپ، روی بخش Crawl کلیک کنید.

- انتخاب گزینه Fetch as Google: در این بخش، گزینه Fetch as Google را انتخاب کنید.

- وارد کردن URL: آدرس دقیق صفحهای را که میخواهید بررسی کنید، وارد کنید. به عنوان مثال، اگر میخواهید بررسی کنید که آیا صفحه اصلی سایت شما قابل ایندکس شدن است یا خیر، آدرس کامل آن را در این قسمت وارد کنید.

- کلیک بر روی Fetch and Render: پس از وارد کردن آدرس، روی دکمه Fetch and Render کلیک کنید.

- بررسی نتایج: بعد از چند لحظه، نتایج درخواست شما نمایش داده میشود. در این قسمت، میتوانید ببینید که آیا گوگل توانسته است به صفحه دسترسی پیدا کند یا خیر و چه خطاهایی در این زمینه وجود دارد. همچنین، میتوانید اطلاعاتی در مورد نحوهی تفسیر فایل robots.txt توسط گوگل و اینکه کدام بخشهای از فایل بر روی این صفحه تاثیرگذار بوده است، مشاهده کنید.

– چه مواردی را در نتایج تست باید بررسی کرد؟

- کد وضعیت: کد وضعیت 200 نشان میدهد که گوگل توانسته است به صفحه دسترسی پیدا کند. کدهای وضعیت دیگر مانند 404 یا 500 نشاندهندهی مشکلاتی در دسترسی به صفحه هستند.

- پیامهای خطا: اگر در فایل robots.txt خطایی وجود داشته باشد، در این بخش نمایش داده میشود.

- بخش Fetch as Google: در این بخش میتوانید ببینید که گوگل چه محتوایی را از صفحه شما ایندکس کرده است.

- بخش Blocked Resources: در این بخش میتوانید ببینید که کدام منابع (مانند تصاویر، فایلهای CSS و …) به دلیل فایل robots.txt مسدود شدهاند.

بهبود سئو با مدیریت دقیق فایل robots.txt

از نظر سئو چند مورد در مورد فایل robots.txt وجود دارد که باید به آنها توجه شود

-توجه به لینکهای داخلی

اگر صفحهای را از ایندکس شدن منع میکنید (با استفاده از دستور disallow)، به یاد داشته باشید که لینکهای داخلی به این صفحه نیز به صورت نوفالو در نظر گرفته میشوند. بنابراین، اگر میخواهید لینکهای داخلی فالو باشند، از روشهای دیگری مانند استفاده از تگ noindex، متا تگ robots یا canonical tag بهره ببرید.

-محدودیت دستور disallow در حفظ حریم خصوصی

استفاده از دستور disallow برای مخفی کردن اطلاعات خصوصی کاربران، روشی مطمئن نیست. اگر صفحهای از طریق لینکهای داخلی به سایر صفحات قابل دسترسی باشد، خزندهها همچنان میتوانند آن را پیدا کنند. برای حفاظت از اطلاعات حساس، بهتر است از روشهای امنیتی قویتری مانند احراز هویت دو مرحلهای و رمزگذاری استفاده کنید.

-بهروزرسانی منظم فایل robots.txt

معمولاً موتورهای جستجو فایل robots.txt را به صورت دورهای بررسی میکنند. با این حال، اگر تغییرات مهمی در ساختار وبسایت خود ایجاد کردهاید، بهتر است فایل robots.txt را بهروزرسانی کرده و این تغییرات را در کنسول جستجوی گوگل نیز ثبت کنید تا موتورهای جستجو سریعتر متوجه تغییرات شوند.

بیشتربخوانید: نقشه سایت چیست؟

نتیجهگیری

فایل robots.txt یک ابزار قدرتمند و اساسی برای هر وبسایت است. با استفاده صحیح از این فایل، میتوانید به موتورهای جستجو بگویید که کدام بخشهای سایت شما برای کاربران مهمتر است و باید در نتایج جستجو نمایش داده شوند.

با کمک متخصصان این حوزه، میتوانید از تمام پتانسیل این فایل برای بهبود سئوی سایت خود استفاده کنید. خدمات دیجیتال مارکتینگ به شما کمک میکند تا با استفاده از ابزارها و تکنیکهای مختلف، وبسایت خود را به یک ماشین درآمدزایی تبدیل کنید.

سوالات متداول

آیا فایل robots.txt یک آسیبپذیری است؟

خیر، فایل robots.txt به خودی خود یک آسیبپذیری نیست، بلکه یک فایل راهنما برای موتورهای جستجو است که به آنها میگوید کدام صفحات را ایندکس کنند و کدام صفحات را نادیده بگیرند.

چه زمانی باید از فایل robots.txt استفاده کنیم؟

فایل robots.txt را زمانی استفاده میکنیم که میخواهیم به موتورهای جستجو بگوییم کدام صفحات وبسایت را ایندکس کنند و کدام را نه.

آیا میتوانم از فایل robots.txt برای پنهان کردن کل سایت از موتورهای جستجو استفاده کنم؟

بله، با استفاده از دستور Disallow: /.

آیا میتوانم فایل robots.txt را برای هر موتور جستجو به صورت جداگانه تنظیم کنم؟

بله، با استفاده از دستور User-agent.

منبع: what is robot.txt